Если вы считаете Colorama полезной, не забудьте поблагодарить ее авторов и сделать пожертвование. Спасибо!

Установка

pip install colorama

# или

conda install -c anaconda colorama

Описание

Управляющие символы ANSI давно используются для создания цветного текста и позиционирования курсора в терминале на Unix и Mac. Colorama делает возможным их использование на платформе Windows, оборачивая stdout, удаляя найденные ANSI-последовательности (которые будут выглядеть как тарабарщина при выводе) и преобразуя их в соответствующие вызовы win32 для изменения состояния командной строки. На других платформах Colorama ничего не меняет.

В результате мы получаем простой кроссплатформенный API для отображения цветного терминального текста из Python, а также следующий приятный побочный эффект: существующие приложения или библиотеки, использующие ANSI-последовательности для создания цветного вывода на Linux или Mac, теперь могут работать и на Windows, просто вызвав colorama.init().

Альтернативный подход заключается в установке ansi.sys на машины с Windows, что обеспечивает одинаковое поведение для всех приложений, работающих с командной строкой. Colorama предназначена для ситуаций, когда это не так просто (например, может быть, у вашего приложения нет программы установки).

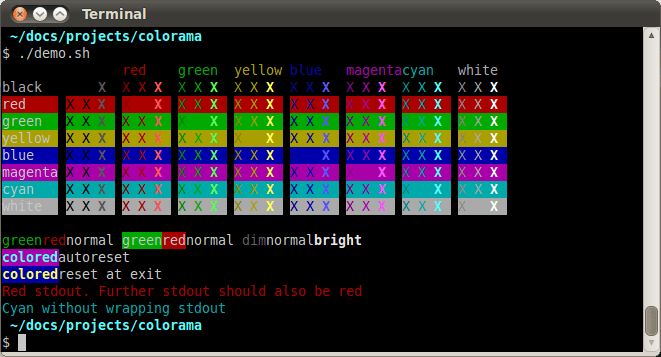

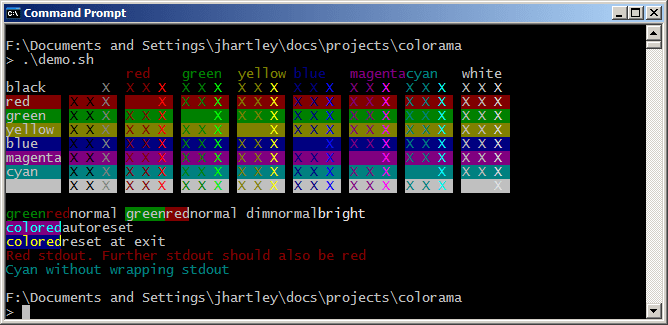

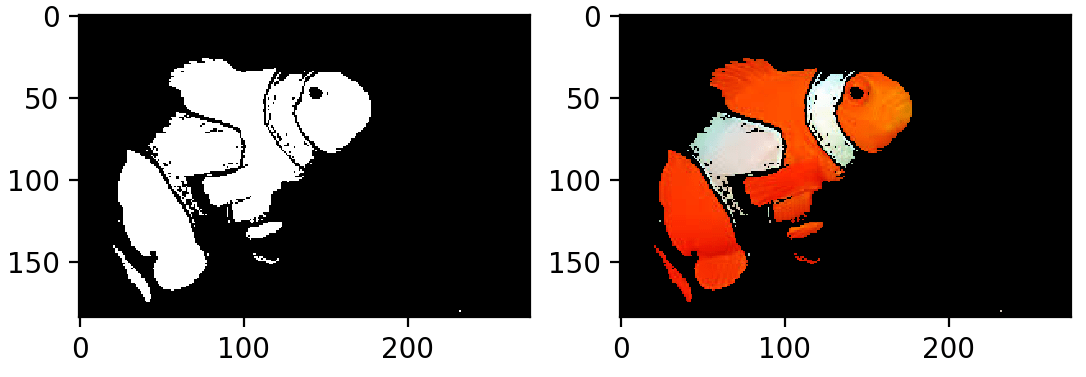

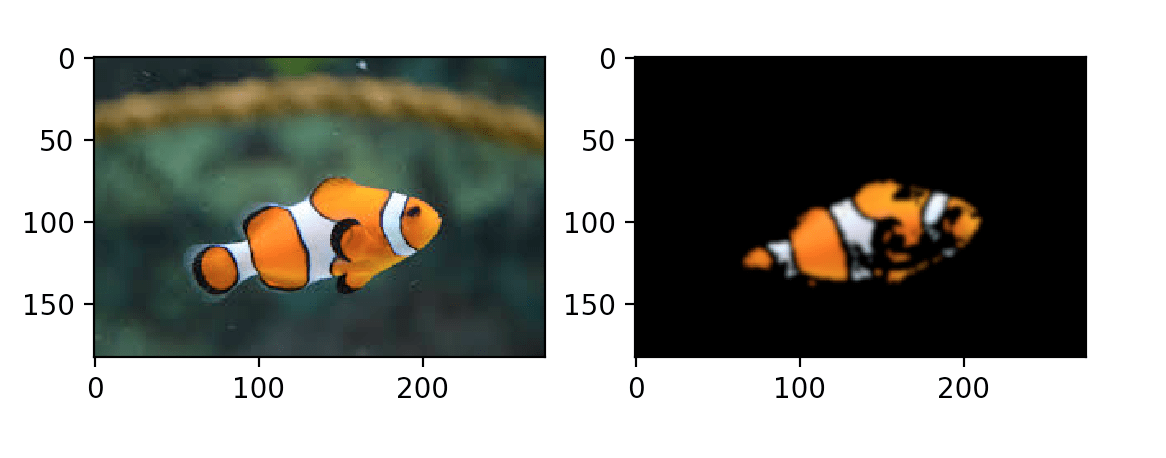

Демо-скрипты в репозитории исходного кода библиотеки выводят небольшой цветной текст, используя последовательности ANSI. Сравните их работу в Gnome-terminal и в Windows Command-Prompt, где отображение осуществляется с помощью Colorama:

Эти скриншоты показывают, что в Windows Colorama не поддерживает ANSI ‘dim text’ (тусклый текст); он выглядит так же, как и ‘normal text’.

Использование

Инициализация

Приложения должны инициализировать Colorama с помощью:

from colorama import init

init()

В Windows вызов init() отфильтрует управляющие ANSI-последовательности из любого текста, отправленного в stdout или stderr, и заменит их на эквивалентные вызовы Win32.

На других платформах вызов init() не имеет никакого эффекта (если только вы не укажете другие дополнительные возможности; см. раздел «Аргументы Init», ниже). По задумке разработчиков такое поведение позволяет приложениям вызывать init() безоговорочно на всех платформах, после чего вывод ANSI должен просто работать.

Чтобы прекратить использование Colorama до выхода из программы, просто вызовите deinit(). Данный метод вернет stdout и stderr к их исходным значениям, так что Colorama будет отключена. Чтобы возобновить ее работу, используйте reinit(); это выгоднее, чем повторный вызов init() (но делает то же самое).

Цветной вывод

Кроссплатформенное отображение цветного текста может быть упрощено за счет использования константных обозначений для управляющих последовательностей ANSI, предоставляемых библиотекой Colorama:

from colorama import init

init()

from colorama import Fore, Back, Style

print(Fore.GREEN + 'зеленый текст')

print(Back.YELLOW + 'на желтом фоне')

print(Style.BRIGHT + 'стал ярче' + Style.RESET_ALL)

print('обычный текст')

При этом вы также можете использовать ANSI-последовательности напрямую в своем коде:

print('\033[31m' + 'красный текст')

print('\033[39m') # сброс к цвету по умолчанию

Еще одним вариантом является применение Colorama в сочетании с существующими ANSI библиотеками, такими как Termcolor или Blessings. Такой подход настоятельно рекомендуется для чего-то большего, чем тривиальное выделение текста:

from colorama import init

from termcolor import colored

# используйте Colorama, чтобы Termcolor работал и в Windows

init()

# теперь вы можете применять Termcolor для вывода

# вашего цветного текста

print(colored('Termcolor and Colorama!', 'red', 'on_yellow'))

Доступны следующие константы форматирования:

// цвет текста

Fore: BLACK, RED, GREEN, YELLOW, BLUE, MAGENTA, CYAN, WHITE, RESET.

// цвет фона

Back: BLACK, RED, GREEN, YELLOW, BLUE, MAGENTA, CYAN, WHITE, RESET.

// яркость текста и общий сброс

Style: DIM, NORMAL, BRIGHT, RESET_ALL

Style.RESET_ALL сбрасывает настройки цвета текста, фона и яркости. Colorama выполнит этот сброс автоматически при выходе из программы.

Позиционирование курсора

Библиотекой поддерживаются ANSI-коды для изменения положения курсора. Пример их генерации смотрите в demos/demo06.py.

Аргументы Init

init() принимает некоторые **kwargs для переопределения поведения по умолчанию.

init(autoreset=False):

Если вы постоянно осуществляете сброс указанных вами цветовых настроек после каждого вывода, init(autoreset=True) будет выполнять это по умолчанию:

from colorama import init, Fore

init(autoreset=True)

print(Fore.GREEN + 'зеленый текст')

print('автоматический возврат к обычному')

init(strip=None):

Передайте True или False, чтобы определить, должны ли коды ANSI удаляться при выводе. Поведение по умолчанию — удаление, если программа запущена на Windows или если вывод перенаправляется (не на tty).

init(convert=None):

Передайте True или False, чтобы определить, следует ли преобразовывать ANSI-коды в выводе в вызовы win32. По умолчанию Colorama будет их конвертировать, если вы работаете под Windows и вывод осуществляется на tty (терминал).

init(wrap=True):

В Windows Colorama заменяет sys.stdout и sys.stderr прокси-объектами, которые переопределяют метод .write() для выполнения своей работы. Если эта обертка вызывает у вас проблемы, то ее можно отключить, передав init(wrap=False). Поведение по умолчанию — обертывание, если autoreset, strip или convert равны True.

Когда обертка отключена, цветной вывод на платформах, отличных от Windows, будет продолжать работать как обычно. Для кроссплатформенного цветного отображения текста можно использовать AnsiToWin32 прокси, предоставляемый Colorama, напрямую:

import sys

from colorama import init, Fore, AnsiToWin32

init(wrap=False)

stream = AnsiToWin32(sys.stderr).stream

# Python 2

print >>stream, Fore.RED + 'красный текст отправлен в stderr'

# Python 3

print(Fore.RED + 'красный текст отправлен в stderr', file=stream)

Распознаваемые ANSI-последовательности

Последовательности ANSI обычно имеют вид:

ESC [ <параметр> ; <параметр> ... <команда>

Где <параметр> — целое число, а <команда> — один символ. В <команда> передается ноль или более параметров. Если параметры не представлены, это, как правило, синоним передачи одного нуля. В последовательности нет пробелов; они были добавлены здесь исключительно для удобства чтения.

Единственные ANSI-последовательности, которые Colorama преобразует в вызовы win32, это:

ESC [ 0 m # сбросить все (цвета и яркость)

ESC [ 1 m # яркий

ESC [ 2 m # тусклый (выглядит так же, как обычная яркость)

ESC [ 22 м # нормальная яркость

# FOREGROUND (цвет текста)

ESC [ 30 м # черный

ESC [ 31 м # красный

ESC [ 32 м # зеленый

ESC [ 33 м # желтый

ESC [ 34 m # синий

ESC [ 35 m # пурпурный

ESC [ 36 m # голубой

ESC [ 37 m # белый

ESC [ 39 m # сброс

# ФОН

ESC [ 40 m # черный

ESC [ 41 m # красный

ESC [ 42 м # зеленый

ESC [ 43 m # желтый

ESC [ 44 m # синий

ESC [ 45 m # пурпурный

ESC [ 46 m # голубой

ESC [ 47 m # белый

ESC [ 49 m # сброс

# позиционирование курсора

ESC [ y;x H # позиционирование курсора в позиции x, y (у направлена вниз)

ESC [ y;x f # позиционирование курсора в точке x, y

ESC [ n A # перемещение курсора на n строк вверх

ESC [ n B # перемещение курсора на n строк вниз

ESC [ n C # перемещение курсора на n символов вперед

ESC [ n D # перемещение курсора на n символов назад

# очистить экран

ESC [ режим J # очистить экран

# очистить строку

ESC [ режим K # очистить строку

Несколько числовых параметров команды ‘m’ могут быть объединены в одну последовательность:

ESC [ 36 ; 45 ; 1 m # яркий голубой текст на пурпурном фоне

Все другие ANSI-последовательности вида ESC [ <параметр> ; <параметр> … <команда> молча удаляются из вывода в Windows.

Любые другие формы ANSI-последовательностей, такие как односимвольные коды или альтернативные начальные символы, не распознаются и не удаляются. Однако было бы здорово добавить их. Вы можете сообщить разработчикам, если это будет полезно для вас, через Issues на GitHub.

Текущий статус и известные проблемы

Лично я тестировал библиотеку только на Windows XP (CMD, Console2), Ubuntu (gnome-terminal, xterm) и OS X.

Некоторые предположительно правильные ANSI-последовательности не распознаются (см. подробности ниже), но, насколько мне известно, никто еще не жаловался на это. Загадка.

См. нерешенные проблемы и список пожеланий: https://github.com/tartley/colorama/issues

Если у вас что-то не работает или делает не то, что вы ожидали, авторы библиотеки будут рады услышать об этом в списке проблем, указанном выше, также они с удовольствием ждут и предоставляют доступ к коммиту любому, кто напишет один или, может, пару рабочих патчей.

]]>Spark предоставляет API для Scala, Java, Python и R. Система поддерживает повторное использование кода между рабочими задачами, пакетную обработку данных, интерактивные запросы, аналитику в реальном времени, машинное обучение и вычисления на графах. Она использует кэширование в памяти и оптимизированное выполнение запросов к данным любого размера.

У нее нет одной собственной файловой системы, такой как Hadoop Distributed File System (HDFS), вместо этого Spark поддерживает множество популярных файловых систем, таких как HDFS, HBase, Cassandra, Amazon S3, Amazon Redshift, Couchbase и т. д.

Преимущества использования Apache Spark:

- Он запускает программы в памяти до 100 раз быстрее, чем Hadoop MapReduce, и в 10 раз быстрее на диске, потому что Spark выполняет обработку в основной памяти рабочих узлов и предотвращает ненужные операции ввода-вывода.

- Spark крайне удобен для пользователя, поскольку имеет API-интерфейсы, написанные на популярных языках, что упрощает задачу для разработчиков: такой подход скрывает сложность распределенной обработки за простыми высокоуровневыми операторами, что значительно снижает объем необходимого кода.

- Систему можно развернуть, используя Mesos, Hadoop через Yarn или собственный диспетчер кластеров Spark.

- Spark производит вычисления в реальном времени и обеспечивает низкую задержку благодаря их резидентному выполнению (в памяти).

Давайте приступим.

Настройка среды в Google Colab

Чтобы запустить pyspark на локальной машине, нам понадобится Java и еще некоторое программное обеспечение. Поэтому вместо сложной процедуры установки мы используем Google Colaboratory, который идеально удовлетворяет наши требования к оборудованию, и также поставляется с широким набором библиотек для анализа данных и машинного обучения. Таким образом, нам остается только установить пакеты pyspark и Py4J. Py4J позволяет программам Python, работающим в интерпретаторе Python, динамически обращаться к объектам Java из виртуальной машины Java.

Итоговый ноутбук можно скачать в репозитории: https://gitlab.com/PythonRu/notebooks/-/blob/master/pyspark_beginner.ipynb

Команда для установки вышеуказанных пакетов:

!pip install pyspark==3.0.1 py4j==0.10.9Spark Session

SparkSession стал точкой входа в PySpark, начиная с версии 2.0: ранее для этого использовался SparkContext. SparkSession — это способ инициализации базовой функциональности PySpark для программного создания PySpark RDD, DataFrame и Dataset. Его можно использовать вместо SQLContext, HiveContext и других контекстов, определенных до 2.0.

Вы также должны знать, что SparkSession внутренне создает SparkConfig и SparkContext с конфигурацией, предоставленной с SparkSession. SparkSession можно создать с помощью SparkSession.builder, который представляет собой реализацию шаблона проектирования Builder (Строитель).

Создание SparkSession

Чтобы создать SparkSession, вам необходимо использовать метод builder().

getOrCreate()возвращает уже существующий SparkSession; если он не существует, создается новый SparkSession.master(): если вы работаете с кластером, вам нужно передать имя своего кластерного менеджера в качестве аргумента. Обычно это будет либоyarn, либоmesosв зависимости от настройки вашего кластера, а при работе в автономном режиме используетсяlocal[x]. Здесь X должно быть целым числом, большим 0. Данное значение указывает, сколько разделов будет создано при использовании RDD, DataFrame и Dataset. В идеалеXдолжно соответствовать количеству ядер ЦП.appName()используется для установки имени вашего приложения.

Пример создания SparkSession:

from pyspark.sql import SparkSession

spark = SparkSession.builder\

.master("local[*]")\

.appName('PySpark_Tutorial')\

.getOrCreate()

# где "*" обозначает все ядра процессора.

Чтение данных

Используя spark.read мы может считывать данные из файлов различных форматов, таких как CSV, JSON, Parquet и других. Вот несколько примеров получения данных из файлов:

# Чтение CSV файла

csv_file = 'data/stocks_price_final.csv'

df = spark.read.csv(csv_file)

# Чтение JSON файла

json_file = 'data/stocks_price_final.json'

data = spark.read.json(json_file)

# Чтение parquet файла

parquet_file = 'data/stocks_price_final.parquet'

data1 = spark.read.parquet(parquet_file)

Структурирование данных с помощью схемы Spark

Давайте прочитаем данные о ценах на акции в США с января 2019 года по июль 2020 года, которые доступны в датасетах Kaggle.

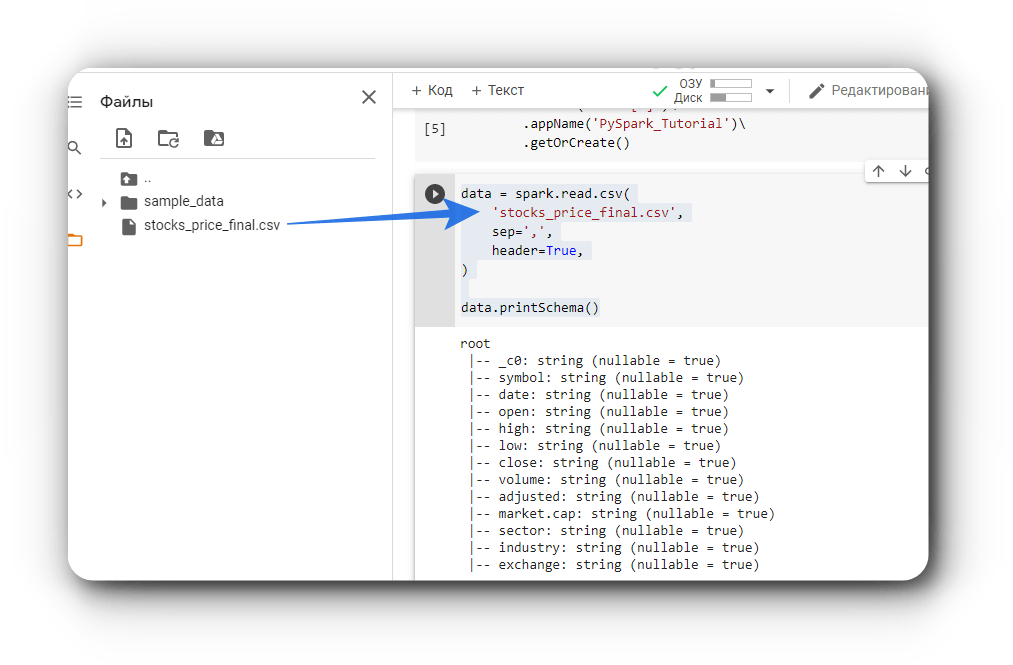

Код для чтения данных в формате файла CSV:

data = spark.read.csv(

'stocks_price_final.csv',

sep=',',

header=True,

)

data.printSchema()

Теперь посмотрим на схему данных с помощью метода PrintSchema.

Схема Spark отображает структуру фрейма данных или датасета. Мы можем определить ее с помощью класса StructType, который представляет собой коллекцию объектов StructField. Они в свою очередь устанавливают имя столбца (String), его тип (DataType), допускает ли он значение NULL (Boolean), и метаданные (MetaData).

Это бывает довольно полезно, даже учитывая, что Spark автоматически выводит схему из данных, так как иногда предполагаемый им тип может быть неверным, или нам необходимо определить собственные имена столбцов и типы данных. Такое часто случается при работе с полностью или частично неструктурированными данными.

Давайте посмотрим, как мы можем структурировать наши данные:

from pyspark.sql.types import *

data_schema = [

StructField('_c0', IntegerType(), True),

StructField('symbol', StringType(), True),

StructField('data', DateType(), True),

StructField('open', DoubleType(), True),

StructField('high', DoubleType(), True),

StructField('low', DoubleType(), True),

StructField('close', DoubleType(), True),

StructField('volume', IntegerType(), True),

StructField('adjusted', DoubleType(), True),

StructField('market.cap', StringType(), True),

StructField('sector', StringType(), True),

StructField('industry', StringType(), True),

StructField('exchange', StringType(), True),

]

final_struc = StructType(fields = data_schema)

data = spark.read.csv(

'stocks_price_final.csv',

sep=',',

header=True,

schema=final_struc

)

data.printSchema()

В приведенном выше коде создается структура данных с помощью StructType и StructField. Затем она передается в качестве параметра schema методу spark.read.csv(). Давайте взглянем на полученную в результате схему структурированных данных:

root

|-- _c0: integer (nullable = true)

|-- symbol: string (nullable = true)

|-- data: date (nullable = true)

|-- open: double (nullable = true)

|-- high: double (nullable = true)

|-- low: double (nullable = true)

|-- close: double (nullable = true)

|-- volume: integer (nullable = true)

|-- adjusted: double (nullable = true)

|-- market.cap: string (nullable = true)

|-- sector: string (nullable = true)

|-- industry: string (nullable = true)

|-- exchange: string (nullable = true)Различные методы инспекции данных

Существуют следующие методы инспекции данных: schema, dtypes, show, head, first, take, describe, columns, count, distinct, printSchema. Давайте разберемся в них на примере.

schema(): этот метод возвращает схему данных (фрейма данных). Ниже показан пример с ценами на акции.

data.schema

# -------------- Вывод ------------------

# StructType(

# List(

# StructField(_c0,IntegerType,true),

# StructField(symbol,StringType,true),

# StructField(data,DateType,true),

# StructField(open,DoubleType,true),

# StructField(high,DoubleType,true),

# StructField(low,DoubleType,true),

# StructField(close,DoubleType,true),

# StructField(volume,IntegerType,true),

# StructField(adjusted,DoubleType,true),

# StructField(market_cap,StringType,true),

# StructField(sector,StringType,true),

# StructField(industry,StringType,true),

# StructField(exchange,StringType,true)

# )

# )

dtypesвозвращает список кортежей с именами столбцов и типами данных.

data.dtypes

#------------- Вывод ------------

# [('_c0', 'int'),

# ('symbol', 'string'),

# ('data', 'date'),

# ('open', 'double'),

# ('high', 'double'),

# ('low', 'double'),

# ('close', 'double'),

# ('volume', 'int'),

# ('adjusted', 'double'),

# ('market_cap', 'string'),

# ('sector', 'string'),

# ('industry', 'string'),

# ('exchange', 'string')]

head(n)возвращает n строк в виде списка. Вот пример:

data.head(3)

# ---------- Вывод ---------

# [

# Row(_c0=1, symbol='TXG', data=datetime.date(2019, 9, 12), open=54.0, high=58.0, low=51.0, close=52.75, volume=7326300, adjusted=52.75, market_cap='$9.31B', sector='Capital Goods', industry='Biotechnology: Laboratory Analytical Instruments', exchange='NASDAQ'),

# Row(_c0=2, symbol='TXG', data=datetime.date(2019, 9, 13), open=52.75, high=54.355, low=49.150002, close=52.27, volume=1025200, adjusted=52.27, market_cap='$9.31B', sector='Capital Goods', industry='Biotechnology: Laboratory Analytical Instruments', exchange='NASDAQ'),

# Row(_c0=3, symbol='TXG', data=datetime.date(2019, 9, 16), open=52.450001, high=56.0, low=52.009998, close=55.200001, volume=269900, adjusted=55.200001, market_cap='$9.31B', sector='Capital Goods', industry='Biotechnology: Laboratory Analytical Instruments', exchange='NASDAQ')

# ]

show()по умолчанию отображает первые 20 строк, а также принимает число в качестве параметра для выбора их количества.first()возвращает первую строку данных.

data.first()

# ----------- Вывод -------------

# Row(_c0=1, symbol='TXG', data=datetime.date(2019, 9, 12), open=54.0, high=58.0, low=51.0,

# close=52.75, volume=7326300, adjusted=52.75, market_cap='$9.31B', sector='Capital Goods',

# industry='Biotechnology: Laboratory Analytical Instruments', exchange='NASDAQ')

take(n)возвращает первые n строк.describe()вычисляет некоторые статистические значения для столбцов с числовым типом данных.columnsвозвращает список, содержащий названия столбцов.

data.columns

# --------------- Вывод --------------

# ['_c0',

# 'symbol',

# 'data',

# 'open',

# 'high',

# 'low',

# 'close',

# 'volume',

# 'adjusted',

# 'market_cap',

# 'sector',

# 'industry',

# 'exchange']count()возвращает общее число строк в датасете.

data.count()

# возвращает количество строк данных

# -------- Вывод ---------

# 1292361distinct()— количество различных строк в используемом наборе данных.printSchema()отображает схему данных.

df.printSchema()

# ------------ Вывод ------------

# root

# |-- _c0: integer (nullable = true)

# |-- symbol: string (nullable = true)

# |-- data: date (nullable = true)

# |-- open: double (nullable = true)

# |-- high: double (nullable = true)

# |-- low: double (nullable = true)

# |-- close: double (nullable = true)

# |-- volume: integer (nullable = true)

# |-- adjusted: double (nullable = true)

# |-- market_cap: string (nullable = true)

# |-- sector: string (nullable = true)

# |-- industry: string (nullable = true)

# |-- exchange: string (nullable = true)Манипуляции со столбцами

Давайте посмотрим, какие методы используются для добавления, обновления и удаления столбцов данных.

1. Добавление столбца: используйте withColumn, чтобы добавить новый столбец к существующим. Метод принимает два параметра: имя столбца и данные. Пример:

data = data.withColumn('date', data.data)

data.show(5)

2. Обновление столбца: используйте withColumnRenamed, чтобы переименовать существующий столбец. Метод принимает два параметра: название существующего столбца и его новое имя. Пример:

data = data.withColumnRenamed('date', 'data_changed')

data.show(5)

3. Удаление столбца: используйте метод drop, который принимает имя столбца и возвращает данные.

data = data.drop('data_changed')

data.show(5)

Работа с недостающими значениями

Мы часто сталкиваемся с отсутствующими значениями при работе с данными реального времени. Эти пропущенные значения обозначаются как NaN, пробелы или другие заполнители. Существуют различные методы работы с пропущенными значениями, некоторые из самых популярных:

- Удаление: удалить строки с пропущенными значениями в любом из столбцов.

- Замена средним/медианным значением: замените отсутствующие значения, используя среднее или медиану соответствующего столбца. Это просто, быстро и хорошо работает с небольшими наборами числовых данных.

- Замена на наиболее частые значения: как следует из названия, используйте наиболее часто встречающееся значение в столбце, чтобы заменить отсутствующие. Это хорошо работает с категориальными признаками, но также может вносить смещение (bias) в данные.

- Замена с использованием KNN: метод K-ближайших соседей — это алгоритм классификации, который рассчитывает сходство признаков новых точек данных с уже существующими, используя различные метрики расстояния, такие как Евклидова, Махаланобиса, Манхэттена, Минковского, Хэмминга и другие. Такой подход более точен по сравнению с вышеупомянутыми методами, но он требует больших вычислительных ресурсов и довольно чувствителен к выбросам.

Давайте посмотрим, как мы можем использовать PySpark для решения проблемы отсутствующих значений:

# Удаление строк с пропущенными значениями

data.na.drop()

# Замена отсутствующих значений средним

data.na.fill(data.select(f.mean(data['open'])).collect()[0][0])

# Замена отсутствующих значений новыми

data.na.replace(old_value, new_vallue)

Получение данных

PySpark и PySpark SQL предоставляют широкий спектр методов и функций для удобного запроса данных. Вот список наиболее часто используемых методов:

- Select

- Filter

- Between

- When

- Like

- GroupBy

- Агрегирование

Select

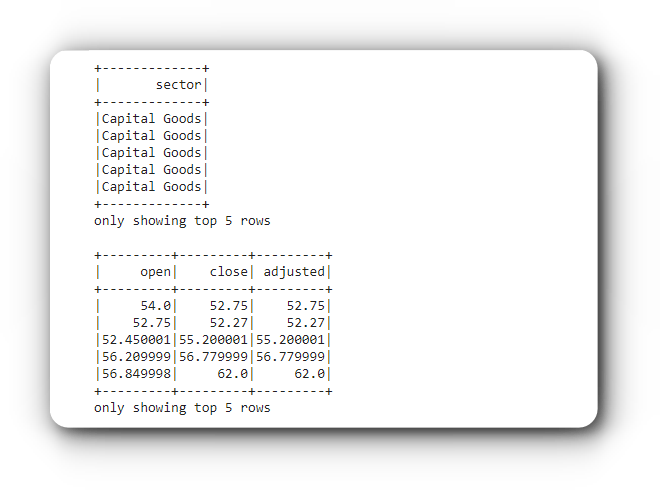

Он используется для выбора одного или нескольких столбцов, используя их имена. Вот простой пример:

# Выбор одного столбца

data.select('sector').show(5)

# Выбор нескольких столбцов

data.select(['open', 'close', 'adjusted']).show(5)

Filter

Данный метод фильтрует данные на основе заданного условия. Вы также можете указать несколько условий, используя операторы AND (&), OR (|) и NOT (~). Вот пример получения данных о ценах на акции за январь 2020 года.

from pyspark.sql.functions import col, lit

data.filter( (col('data') >= lit('2020-01-01')) & (col('data') <= lit('2020-01-31')) ).show(5)

Between

Этот метод возвращает True, если проверяемое значение принадлежит указанному отрезку, иначе — False. Давайте посмотрим на пример отбора данных, в которых значения adjusted находятся в диапазоне от 100 до 500.

data.filter(data.adjusted.between(100.0, 500.0)).show()

When

Он возвращает 0 или 1 в зависимости от заданного условия. В приведенном ниже примере показано, как выбрать такие цены на момент открытия и закрытия торгов, при которых скорректированная цена была больше или равна 200.

data.select('open', 'close',

f.when(data.adjusted >= 200.0, 1).otherwise(0)

).show(5)

Like

Этот метод похож на оператор Like в SQL. Приведенный ниже код демонстрирует использование rlike() для извлечения имен секторов, которые начинаются с букв M или C.

data.select(

'sector',

data.sector.rlike('^[B,C]').alias('Колонка sector начинается с B или C')

).distinct().show()

GourpBy

Само название подсказывает, что данная функция группирует данные по выбранному столбцу и выполняет различные операции, такие как вычисление суммы, среднего, минимального, максимального значения и т. д. В приведенном ниже примере объясняется, как получить среднюю цену открытия, закрытия и скорректированную цену акций по отраслям.

data.select(['industry', 'open', 'close', 'adjusted'])\

.groupBy('industry')\

.mean()\

.show()

Агрегирование

PySpark предоставляет встроенные стандартные функции агрегации, определенные в API DataFrame, они могут пригодится, когда нам нужно выполнить агрегирование значений ваших столбцов. Другими словами, такие функции работают с группами строк и вычисляют единственное возвращаемое значение для каждой группы.

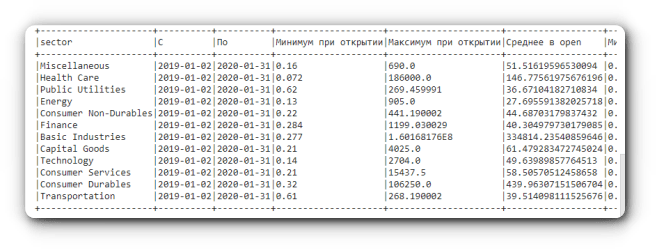

В приведенном ниже примере показано, как отобразить минимальные, максимальные и средние значения цен открытия, закрытия и скорректированных цен акций в промежутке с января 2019 года по январь 2020 года для каждого сектора.

from pyspark.sql import functions as f

data.filter((col('data') >= lit('2019-01-02')) & (col('data') <= lit('2020-01-31')))\

.groupBy("sector") \

.agg(f.min("data").alias("С"),

f.max("data").alias("По"),

f.min("open").alias("Минимум при открытии"),

f.max("open").alias("Максимум при открытии"),

f.avg("open").alias("Среднее в open"),

f.min("close").alias("Минимум при закрытии"),

f.max("close").alias("Максимум при закрытии"),

f.avg("close").alias("Среднее в close"),

f.min("adjusted").alias("Скорректированный минимум"),

f.max("adjusted").alias("Скорректированный максимум"),

f.avg("adjusted").alias("Среднее в adjusted"),

).show(truncate=False)

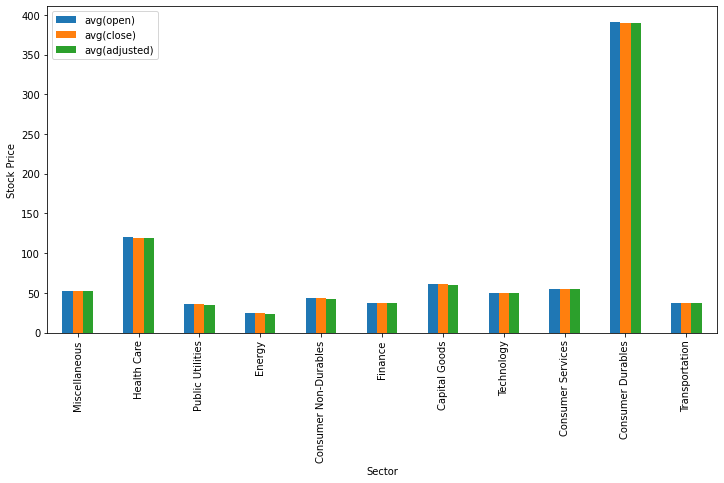

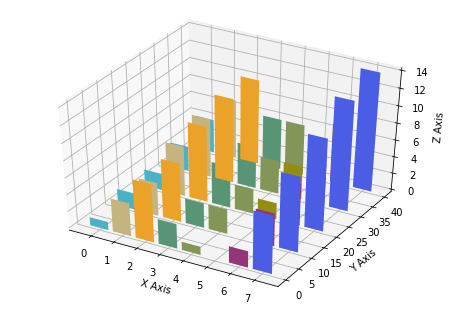

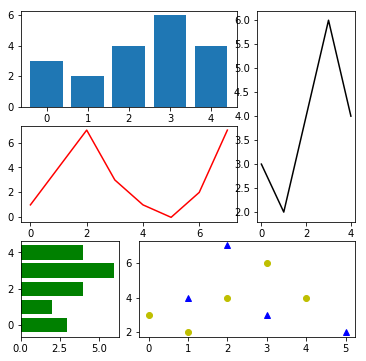

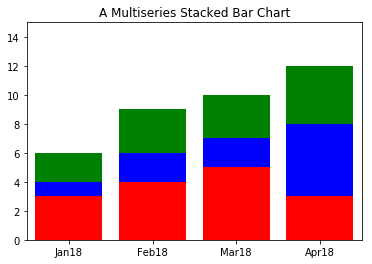

Визуализация данных

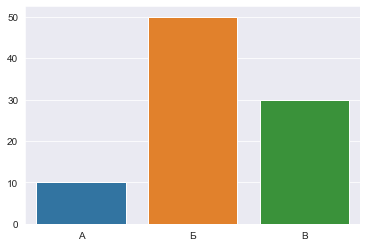

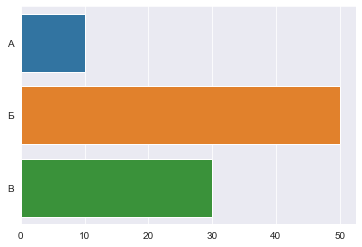

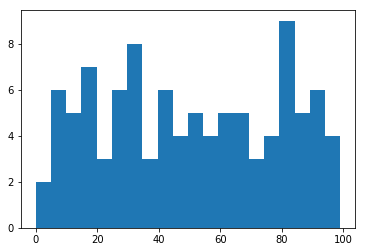

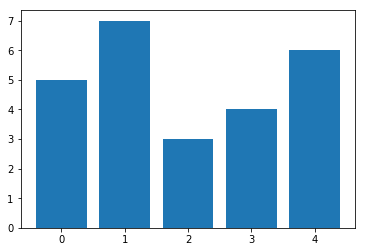

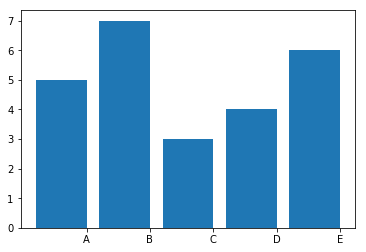

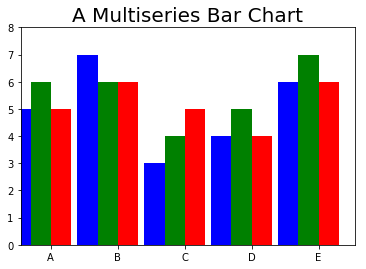

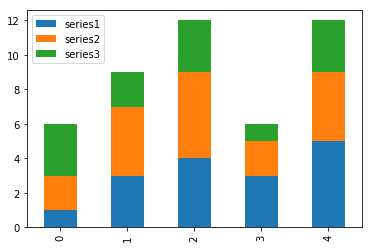

Для визуализации данных мы воспользуемся библиотеками matplotlib и pandas. Метод toPandas() позволяет нам осуществить преобразование данных в dataframe pandas, который мы используем при вызове метода визуализации plot(). В приведенном ниже коде показано, как отобразить гистограмму, отображающую средние значения цен открытия, закрытия и скорректированных цен акций для каждого сектора.

from matplotlib import pyplot as plt

sec_df = data.select(['sector',

'open',

'close',

'adjusted']

)\

.groupBy('sector')\

.mean()\

.toPandas()

ind = list(range(12))

ind.pop(6)

sec_df.iloc[ind ,:].plot(kind='bar', x='sector', y=sec_df.columns.tolist()[1:],

figsize=(12, 6), ylabel='Stock Price', xlabel='Sector')

plt.show()

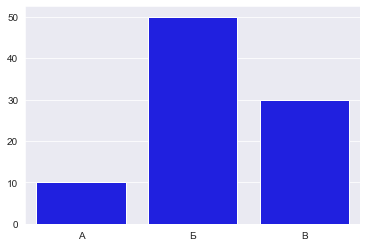

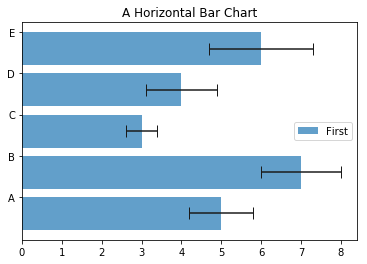

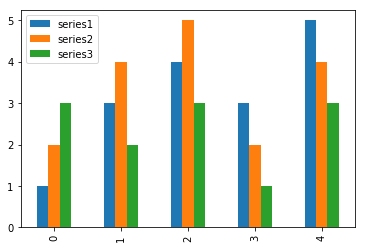

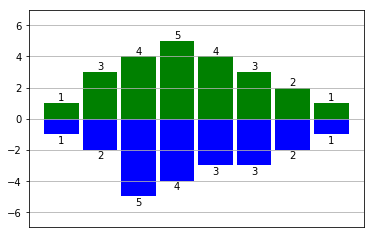

Теперь давайте визуализируем те же средние показатели, но уже по отраслям.

industries_x = data.select(['industry', 'open', 'close', 'adjusted']).groupBy('industry').mean().toPandas()

q = industries_x[(industries_x.industry != 'Major Chemicals') & (industries_x.industry != 'Building Products')]

q.plot(kind='barh', x='industry', y=q.columns.tolist()[1:], figsize=(10, 50), xlabel='Stock Price', ylabel='Industry')

plt.show()

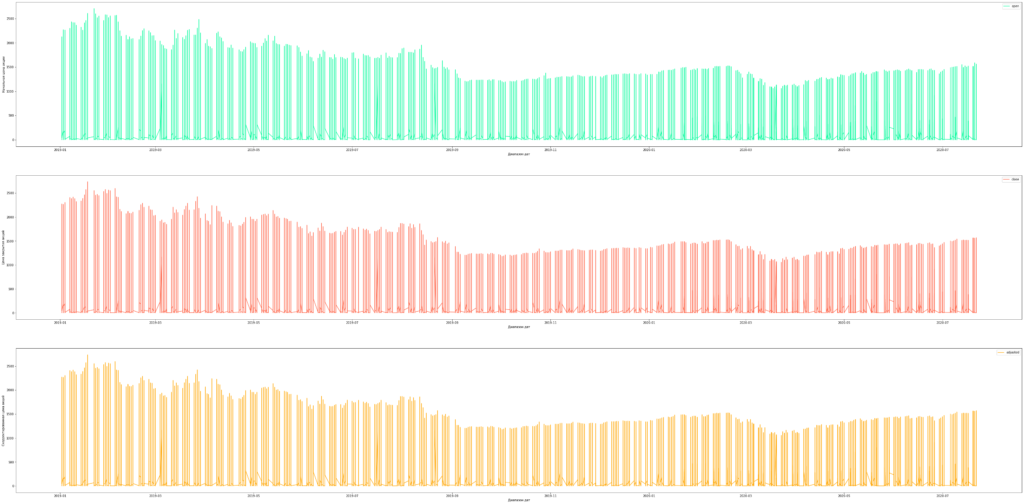

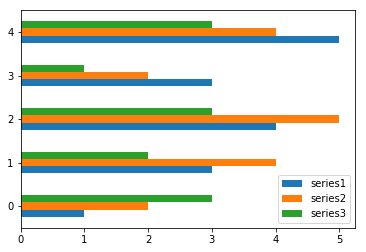

Также построим временные ряды для средних цен открытия, закрытия и скорректированных цен акций технологического сектора.

industries_x = data.select(['industry', 'open', 'close', 'adjusted']).groupBy('industry').mean().toPandas()

q = industries_x[(industries_x.industry != 'Major Chemicals') & (industries_x.industry != 'Building Products')]

q.plot(kind='barh', x='industry', y=q.columns.tolist()[1:], figsize=(10, 50), xlabel='Stock Price', ylabel='Industry')

plt.show()

Запись/сохранение данных в файл

Метод write.save() используется для сохранения данных в различных форматах, таких как CSV, JSVON, Parquet и других. Давайте рассмотрим, как записать данные в файлы разных форматов. Мы можем сохранить как все строки, так и только выбранные с помощью метода select().

# CSV

data.write.csv('dataset.csv')

# JSON

data.write.save('dataset.json', format='json')

# Parquet

data.write.save('dataset.parquet', format='parquet')

# Запись выбранных данных в различные форматы файлов

# CSV

data.select(['data', 'open', 'close', 'adjusted'])\

.write.csv('dataset.csv')

# JSON

data.select(['data', 'open', 'close', 'adjusted'])\

.write.save('dataset.json', format='json')

# Parquet

data.select(['data', 'open', 'close', 'adjusted'])\

.write.save('dataset.parquet', format='parquet')

Заключение

PySpark — отличный инструмент для специалистов по данным, поскольку он обеспечивает масштабируемые анализ и ML-пайплайны. Если вы уже знакомы с Python, SQL и Pandas, тогда PySpark — хороший вариант для быстрого старта.

В этой статье было показано, как следует выполнять широкий спектр операций, начиная с чтения файлов и заканчивая записью результатов с помощью PySpark. Также мы охватили основные методы визуализации с использованием библиотеки matplotlib.

Мы узнали, что Google Colaboratory Notebooks — это удобное место для начала изучения PySpark без долгой установки необходимого программного обеспечения. Не забудьте ознакомиться с представленными ниже ссылками на ресурсы, которые могут помочь вам быстрее и проще изучить PySpark.

Также не стесняйтесь использовать предоставленный в статье код, доступ к которому можно получить, перейдя на Gitlab. Удачного обучения.

]]>Gensim может работать с большими текстовыми коллекциями. Этим она отличается от других программных библиотек машинного обучения, ориентированных на обработку в памяти. GenSim также предоставляет эффективные многоядерные реализации различных алгоритмов для увеличения скорости обработки. В нее добавлены более удобные средства для обработки текста, чем у конкурентов, таких как Scikit-learn, R и т. д.

В этом руководстве будут рассмотрены следующие концепции:

- Создание корпуса из заданного датасета.

- Матрицы TFIDF в Gensim.

- Создание биграммы и триграммы с помощью Gensim.

- Модели Word2Vec, с использованием Gensim.

- Модели Doc2Vec, с использованием Gensim.

- Создание тематической модели с LDA.

- Создание тематической модели с LSI.

Прежде чем двигаться дальше, давайте разберемся, что означают следующие термины:

- Корпус: коллекция текстовых документов.

- Вектор: форма представления текста.

- Модель: алгоритм, используемый для генерации представления данных.

- Тематическое моделирование: инструмент интеллектуального анализа информации, который используется для извлечения семантических тем из документов.

- Тема: повторяющаяся группа слов, часто встречающихся вместе.

Например:

У вас есть документ, состоящий из таких слов, как:

bat, car, racquet, score, glass, drive, cup, keys, water, game, steering, liquid.

Их можно сгруппировать по разным темам:

| Тема 1 | Тема 2 | Тема 3 |

|---|---|---|

| glass | bat | car |

| cup | racquet | drive |

| water | score | keys |

| liquid | game | sterring |

Некоторые из методов тематического моделирования:

- Латентно-семантический анализ (LSI)

- Латентное размещение Дирихле (LDA)

Теперь, когда у нас есть базовое понимание терминологии, давайте перейдем к использованию пакета Gensim. Сначала установите библиотеку с помощью следующих команд:

pip install gensim

# или

conda install gensimШаг 1. Создайте корпус из заданного датасета

Вам необходимо выполнить следующие шаги, чтобы создать свою коллекцию документов:

- Загрузите выбранный датасет.

- Проведите предварительную обработку вашего набора данных.

- Создайте словарь.

- Создайте Bag of Words.

1.1 Загрузите выбранный датасет:

У вас может быть файл .txt в качестве набора данных или вы также можете загрузить необходимые датасеты с помощью API Gensim Downloader.

import os

# прочитать текстовый файл как объект

doc = open('sample_data.txt', encoding ='utf-8')

Gensim Downloader API – это модуль, доступный в библиотеке Gensim, который представляет собой API для скачивания, получения информации и загрузки датасетов/моделей.

import gensim.downloader as api

# проверка имеющихся моделей и датасетов

info_datasets = api.info()

print(info_datasets)

# информация ы конкретном наборе данных

dataset_info = api.info("text8")

# загрузка набора данных "text8"

dataset = api.load("text8")

# загрузка предварительно обученной модели

word2vec_model = api.load('word2vec-google-news-300')

Здесь мы будем использовать текстовый файл как необработанный набор данных, которые представляют собой текст со страницы Википедии.

1.2 Предварительная обработка набора данных

В NLP под предварительной обработкой текста понимают процесс очистки и подготовки текстовых данных. Для этого мы воспользуемся функцией simple_preprocess(), которая возвращает список токенов после их токенизации и нормализации.

import gensim

import os

from gensim.utils import simple_preprocess

# прочитать текстовый файл как объект

doc = open('nlp-wiki.txt', encoding ='utf-8')

# предварительная обработка файла для получения списка токенов

tokenized = []

for sentence in doc.read().split('.'):

# функция simple_preprocess возвращает список слов каждого предложения

tokenized.append(simple_preprocess(sentence, deacc = True))

print(tokenized)

doc.close()

Токенизированный вывод:

[['the', 'history', 'of', 'natural', 'language', 'processing', 'generally', 'started', 'in', 'the', 'although', 'work', 'can', 'be', 'found', 'from', 'earlier', 'periods'], ['in', 'alan', 'turing', 'published', 'an', 'article', 'titled', 'intelligence', 'which', 'proposed', 'what', 'is', 'now', 'called', 'the', 'turing', 'test', 'as', 'criterion', 'of', 'intelligence'], ['the', 'georgetown', 'experiment', 'in', 'involved', 'fully', 'automatic', 'translation', 'of', 'more', 'than', 'sixty', 'russian', 'sentences', 'into', 'english'], ['the', 'authors', 'claimed', 'that', 'within', 'three', 'or', 'five', 'years', 'machine', 'translation', 'would', 'be', 'solved', 'problem'],

...1.3 Создание словаря

Теперь у нас есть предварительно обработанные данные, которые можно преобразовать в словарь с помощью функции corpora.Dictionary(). Этот словарь представляет собой коллекцию уникальных токенов.

from gensim import corpora

# сохранение извлеченных токенов в словарь

my_dictionary = corpora.Dictionary(tokenized)

print(my_dictionary)

Dictionary(410 unique tokens: ['although', 'be', 'can', 'earlier', 'found']...)

1.3.1 Сохранение словаря

Вы можете сохранить (или загрузить) свой словарь на диске напрямую, а также в виде текстового файла, как показано ниже:

# сохраните словарь на диске

my_dictionary.save('my_dictionary.dict')

# загрузите обратно

load_dict = corpora.Dictionary.load('my_dictionary.dict')

# сохраните словарь в текстовом файле

from gensim.test.utils import get_tmpfile

tmp_fname = get_tmpfile("dictionary")

my_dictionary.save_as_text(tmp_fname)

# загрузите текстовый файл с вашим словарем

load_dict = corpora.Dictionary.load_from_text(tmp_fname)

1.4 Создание Bag of Words

Когда у нас есть словарь, мы можем создать корпус Bag of Words с помощью функции doc2bow(). Эта функция подсчитывает число вхождений и генерирует целочисленный идентификатор для каждого слова. Результат возвращается в виде разреженного вектора.

# преобразование в слов Bag of Word

bow_corpus =[my_dictionary.doc2bow(doc, allow_update = True) for doc in tokenized]

print(bow_corpus)

[[(0, 1), (1, 1), (2, 1),

...

(407, 1), (408, 1), (409, 1)], []]

1.4.1 Сохранение корпуса на диск

Код для сохранения/загрузки вашего корпуса:

from gensim.corpora import MmCorpus

from gensim.test.utils import get_tmpfile

output_fname = get_tmpfile("BoW_corpus.mm")

# сохранение корпуса на диск

MmCorpus.serialize(output_fname, bow_corpus)

# загрузка корпуса

load_corpus = MmCorpus(output_fname)

Шаг 2: Создание матрицы TF-IDF в Gensim

TF-IDF (Term Frequency – Inverse Document Frequency) – это часто используемая модель обработки естественного языка, которая помогает вам определять самые важные слова для каждого документа в корпусе. Она была разработана для коллекций небольшого размера.

Некоторые слова могут не являться стоп-словами, но при этом довольно часто встречаться в документах, имея малую значимость. Следовательно, эти слова необходимо удалить или снизить их важность. Модель TFIDF берет текст, написанный на одном языке, и гарантирует, что наиболее распространенные слова во всем корпусе не будут отображаться в качестве ключевых слов.

Вы можете построить модель TFIDF, используя Gensim и корпус, который вы разработали ранее, следующий образом:

from gensim import models

import numpy as np

# Вес слова в корпусе Bag of Word

word_weight =[]

for doc in bow_corpus:

for id, freq in doc:

word_weight.append([my_dictionary[id], freq])

print(word_weight)

Вес слов перед применением TF-IDF:

[['although', 1], ['be', 1], ['can', 1], ['earlier', 1],

...

['steps', 1], ['term', 1], ['transformations', 1]]Код (применение модели TF-IDF):

# создать модель TF-IDF

tfIdf = models.TfidfModel(bow_corpus, smartirs ='ntc')

# TF-IDF вес слова

weight_tfidf =[]

for doc in tfIdf[bow_corpus]:

for id, freq in doc:

weight_tfidf.append([my_dictionary[id], np.around(freq, decimals=3)])

print(weight_tfidf)

Вес слов после применением TF-IDF:

[['although', 0.339], ['be', 0.19], ['can', 0.237], ['earlier', 0.339],

...

['steps', 0.191], ['term', 0.191], ['transformations', 0.191]]

Вы можете видеть, что словам, часто встречающимся в документах, теперь присвоены более низкие веса.

Шаг 3. Создание биграмм и триграмм с помощью Gensim

Многие слова употребляются в тексте вместе. Такие сочетания имеют другое значение, чем составляющие их слова по отдельности.

Например:

Beatboxing -> слова beat и boxing имеют собственные смысловые вариации, но вместе они представляют совсем иное значение.

Биграмма — группа из двух слов.

Триграмма — группа из трех слов.

Здесь мы будем использовать датасет text8, который можно загрузить с помощью API downloader Gensim. Код построения биграмм и триграмм:

import gensim.downloader as api

from gensim.models.phrases import Phrases

# загрузка набора данных "text8"

dataset = api.load("text8")

# извлечь список слов из датасета

data =[]

for word in dataset:

data.append(word)

# Биграм с использованием модели фразера

bigram_model = Phrases(data, min_count=3, threshold=10)

print(bigram_model[data[0]])

['anarchism', 'originated', 'as', 'a', 'term', 'of', 'abuse', 'first', 'used', 'against', 'early', 'working_class', 'radicals', 'including', 'the', 'diggers', 'of', 'the', 'english', 'revolution', 'and', 'the', 'sans_culottes', 'of', 'the', 'french_revolution', 'whilst', 'the', 'term', 'is', 'still' ...Для создания триграмм мы просто передаем полученную выше биграммную модель той же функции.

# Триграмма с использованием модели фразы

trigram_model = Phrases(bigram_model[data], threshold=10)

# Триграмма

print(trigram_model[bigram_model[data[0]]])

['anarchism', 'originated', 'as', 'a', 'term', 'of', 'abuse', 'first', 'used', 'against', 'early' ...Шаг 4: Создайте модель Word2Vec с помощью Gensim

Алгоритмы ML/DL не могут использовать текст напрямую, поэтому нам нужно некоторое числовое представление, чтобы эти алгоритмы могли обрабатывать данные. В простых приложениях машинного обучения используются CountVectorizer и TFIDF, которые не сохраняют связь между словами.

Word2Vec — метод преобразования текста для создания векторных представлений (Word Embeddings), которые отображают все слова, присутствующие в языке, в векторное пространство заданной размерности. Мы можем выполнять математические операции с этими векторами, которые помогают сохранить связь между словами.

Пример: queen — women + man = king.

Готовые векторно-семантические модели, такие как word2vec, GloVe, fasttext и другие можно загрузить с помощью API загрузчика Gensim. Иногда векторные представления определенных слов из вашего документа могут отсутствовать в упомянутых пакетах. Но вы можете решить данную проблему, обучив свою модель.

4.1) Обучение модели

import gensim.downloader as api

from multiprocessing import cpu_count

from gensim.models.word2vec import Word2Vec

# загрузка набора данных "text8"

dataset = api.load("text8")

# извлечь список слов из датасета

data =[]

for word in dataset:

data.append(word)

# Разделим данные на две части

data_1 = data[:1200] # используется для обучения модели

data_2 = data[1200:] # используется для обновления модели

# Обучение модели Word2Vec

w2v_model = Word2Vec(data_1, min_count=0, workers=cpu_count())

# вектор слов для слова "время"

print(w2v_model.wv['time'])

Вектор для слова «time»:

[-0.04681756 -0.08213229 1.0628034 -1.0186515 1.0779341 -0.89710116

0.6538859 -0.81849015 -0.29984367 0.55887854 2.138567 -0.93843514

...

-1.4128548 -1.3084044 0.94601256 0.27390406 0.6346426 -0.46116787

0.91097695 -3.597664 0.6901859 1.0902803 ]Вы также можете использовать функцию most_similar(), чтобы найти слова, похожие на переданное.

# слова, похожие на "time"

print(w2v_model.wv.most_similar('time'))

# сохранение и загрузка модели

w2v_model.save('Word2VecModel')

model = Word2Vec.load('Word2VecModel')

Cлова, наиболее похожие на «time»:

[('moment', 0.6137239933013916), ('period', 0.5904807448387146), ('stage', 0.5393826961517334), ('decade', 0.51670902967453), ('lifetime', 0.4878680109977722), ('once', 0.4843854010105133), ('distance', 0.4821343719959259), ('breteuil', 0.4815649390220642), ('preestablished', 0.47662678360939026), ('point', 0.4757876396179199)]4.2) Обновление модели

# построим словарный запас по образцу из последовательности предложений

w2v_model.build_vocab(data_2, update=True)

# обучение вектора слов

w2v_model.train(data_2, total_examples=w2v_model.corpus_count, epochs=w2v_model.epochs)

print(w2v_model.wv['time'])

На выходе вы получите новые веса для слов.

Шаг 5: Создание модели Doc2Vec с помощью Gensim

В отличие от модели Word2Vec, модель Doc2Vec генерирует векторное представление для всего документа или группы слов. С помощью этой модели мы можем найти взаимосвязь между различными документами, как показано ниже:

Если натренировать модель на литературе типа «Алиса в Зазеркалье». Мы можем сказать, что

Алиса в Зазеркалье == Алиса в Стране чудес.

5.1) Обучите модель

import gensim

import gensim.downloader as api

from gensim.models import doc2vec

# получить датасета

dataset = api.load("text8")

data =[]

for w in dataset:

data.append(w)

# Для обучения модели нам нужен список целевых документов

def tagged_document(list_of_ListOfWords):

for x, ListOfWords in enumerate(list_of_ListOfWords):

yield doc2vec.TaggedDocument(ListOfWords, [x])

# тренировочные данные

data_train = list(tagged_document(data))

# вывести обученный набор данных

print(data_train[:1])

Вывод – обученный датасет.

5.2) Обновите модель

# Инициализация модели

d2v_model = doc2vec.Doc2Vec(vector_size=40, min_count=2, epochs=30)

# расширить словарный запас

d2v_model.build_vocab(data_train)

# Обучение модели Doc2Vec

d2v_model.train(data_train, total_examples=d2v_model.corpus_count, epochs=d2v_model.epochs)

# Анализ выходных данных

analyze = d2v_model.infer_vector(['violent', 'means', 'to', 'destroy'])

print(analyze)

Вывод обновленной модели:

[-3.79053354e-02 -1.03341974e-01 -2.85615563e-01 1.37473553e-01

1.79868549e-01 3.42468806e-02 -1.68495290e-02 -1.86038092e-01

...

-1.20517321e-01 -1.48323074e-01 -5.70210926e-02 -2.15077385e-01]Шаг 6. Создание тематической модели с помощью LDA

LDA – популярный метод тематического моделирования, при котором каждый документ рассматривается как совокупность тем в определенной пропорции. Нам нужно вывести полезные качества тем, например, насколько они разделены и значимы. Темы хорошего качества зависят от:

- качества обработки текста,

- нахождения оптимального количества тем,

- настройки параметров алгоритма.

Выполните следующие шаги, чтобы создать модель.

6.1 Подготовка данных

Это делается путем удаления стоп-слов и последующей лемматизации ваших данных. Чтобы выполнить лемматизацию с помощью Gensim, нам нужно сначала загрузить пакет шаблонов и стоп-слова.

pip install pattern

# в python консоле

>>> import nltk

>>> nltk.download('stopwords')

import gensim

from gensim import corpora

from gensim.models import LdaModel, LdaMulticore

import gensim.downloader as api

from gensim.utils import simple_preprocess

import nltk

from nltk.stem.wordnet import WordNetLemmatizer

# nltk.download('stopwords')

from nltk.corpus import stopwords

import re

import logging

logging.basicConfig(format='%(asctime)s : %(levelname)s : %(message)s')

logging.root.setLevel(level=logging.INFO)

# загрузка stopwords

stop_words = stopwords.words('english')

# добавление stopwords

stop_words = stop_words + ['subject', 'com', 'are', 'edu', 'would', 'could']

lemmatizer = WordNetLemmatizer()

# загрузка датасета

dataset = api.load("text8")

data = [w for w in dataset]

# подготовка данных

processed_data = []

for x, doc in enumerate(data[:100]):

doc_out = []

for word in doc:

if word not in stop_words: # для удаления стоп-слов

lemmatized_word = lemmatizer.lemmatize(word) # лемматизация

if lemmatized_word:

print

doc_out.append(lemmatized_word)

else:

continue

processed_data.append(doc_out) # processed_data это список слов

# вывод образца

print(processed_data[0][:10])

['anarchism', 'originated', 'term', 'abuse', 'first', 'used', 'early', 'working', 'class', 'radical']6.2 Создание словаря и корпуса

Обработанные данные теперь будут использоваться для создания словаря и корпуса.

dictionary = corpora.Dictionary(processed_data)

corpus = [dictionary.doc2bow(l) for l in processed_data]

6.3 Обучение LDA-модели

Мы будем обучать модель LDA с 5 темами, используя словарь и корпус, созданные ранее. Здесь используется функция LdaModel(), но вы также можете использовать функцию LdaMulticore(), поскольку она позволяет выполнять параллельную обработку.

# Обучение

LDA_model = LdaModel(corpus=corpus, id2word=dictionary, num_topics=5)

# сохранение модели

LDA_model.save('LDA_model.model')

# показать темы

print(LDA_model.print_topics(-1))

Слова, которые встречаются в более чем одной теме и имеют малое значение, могут быть добавлены в список запрещенных слов.

6.4 Интерпретация вывода

Модель LDA в основном дает нам информацию по трем направлениям:

- Темы в документе

- К какой теме принадлежит каждое слово

- Значение фи

Значением фи является вероятность того, что слово относится к определенной теме. Для выбранного слова сумма значений фи дает количество раз, оно встречается в документе.

# вероятность принадлежности слова к теме

LDA_model.get_term_topics('fire')

bow_list =['time', 'space', 'car']

# сначала преобразуйте в bag of words

bow = LDA_model.id2word.doc2bow(bow_list)

# интерпретация данных

doc_topics, word_topics, phi_values = LDA_model.get_document_topics(bow, per_word_topics=True)

Шаг 7. Создание тематической модели с помощью LSI

Чтобы создать модель с LSI, просто выполните те же шаги, что и с LDA.

Только для обучения используйте функцию LsiModel() вместо LdaMulticore() или LdaModel().

from gensim.models import LsiModel

# Обучение модели с помощью LSI

LSI_model = LsiModel(corpus=corpus, id2word=dictionary, num_topics=7, decay=0.5)

# темы

print(LSI_model.print_topics(-1))

Заключение

Это только некоторые из возможностей библиотеки Gensim. Пользоваться ими очень удобно, особенно когда вы занимаетесь NLP. Вы, конечно, можете применять их по своему усмотрению.

]]>При использовании SQLAlchemy ORM взаимодействие с базой данных происходит через объект Session. Он также захватывает соединение с базой данных и транзакции. Транзакция неявно стартует как только Session начинает общаться с базой данных и остается открытой до тех пор, пока Session не коммитится, откатывается или закрывается.

Для создания объекта session можно использовать класс Session из sqlalchemy.orm.

from sqlalchemy import create_engine

from sqlalchemy.orm import Session

engine = create_engine("postgresql+psycopg2://postgres:1111@localhost/sqlalchemy_tuts")

session = Session(bind=engine)

Создавать объект Session нужно будет каждый раз при взаимодействии с базой.

Конструктор Session принимает определенное количество аргументов, которые определяют режим его работы. Если создать сессию таким способом, то в дальнейшем конструктор Session нужно будет вызывать с одним и тем же набором параметров.

Чтобы упростить этот процесс, SQLAlchemy предоставляет класс sessionmaker, который создает класс Session с аргументами для конструктора по умолчанию.

from sqlalchemy.orm import Session, sessionmaker

session = sessionmaker(bind=engine)

Нужно просто вызвать sessionmaker один раз в глобальной области видимости.

Получив доступ к этому классу Session раз, можно создавать его экземпляры любое количество раз, не передавая параметры.

session = Session()Обратите внимание на то, что объект Session не сразу устанавливает соединение с базой данных. Это происходит лишь при первом запросе.

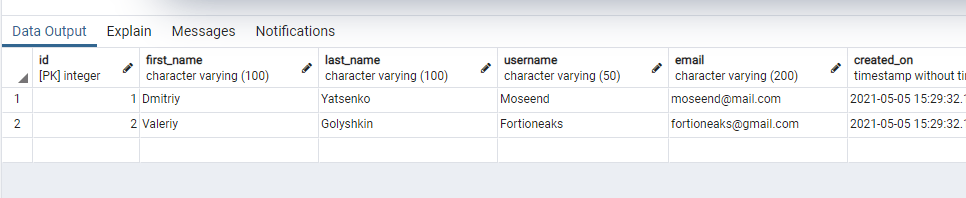

Вставка(добавление) данных

Для создания новой записи с помощью SQLAlchemy ORM нужно выполнить следующие шаги:

- Создать объект

- Добавить его в сессию

- Сохранить сессию

Создадим два новых объекта Customer:

c1 = Customer(

first_name = 'Dmitriy',

last_name = 'Yatsenko',

username = 'Moseend',

email = 'moseend@mail.com'

)

c2 = Customer(

first_name = 'Valeriy',

last_name = 'Golyshkin',

username = 'Fortioneaks',

email = 'fortioneaks@gmail.com'

)

print(c1.first_name, c2.last_name)

session.add(c1)

session.add(c2)

print(session.new)

session.commit()

Первый вывод: Dmitriy Golyshkin.

Два объекта созданы. Получить доступ к их атрибутам можно с помощью оператора точки (.).

Дальше в сессию добавляются объекты.

session.add(c1)

session.add(c2)Но добавление объектов не влияет на запись в базу, а лишь готовит объекты к сохранению в следующем коммите. Проверить это можно, получив первичные ключи объектов.

Значение атрибута id обоих объектов — None. Это значит, что они еще не сохранены в базе данных.

Вместо добавления одного объекта за раз можно использовать метод add_all(). Он принимает список объектов, которые будут добавлены в сессию.

session.add_all([c1, c2])Добавление объекта в сессию несколько раз не приводит к ошибкам. В любой момент на имеющиеся объекты можно посмотреть с помощью session.new.

IdentitySet([<__main__.Customer object at 0x000001BD25928C40>, <__main__.Customer object at 0x000001BD25928C70>])Наконец, для сохранения данных используется метод commit():

session.commit()После сохранения транзакции ресурсы соединения, на которые ссылается объект Session, возвращаются в пул соединений. Последующие операции будут выполняться в новой транзакции.

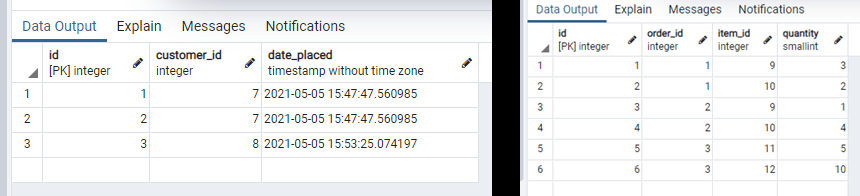

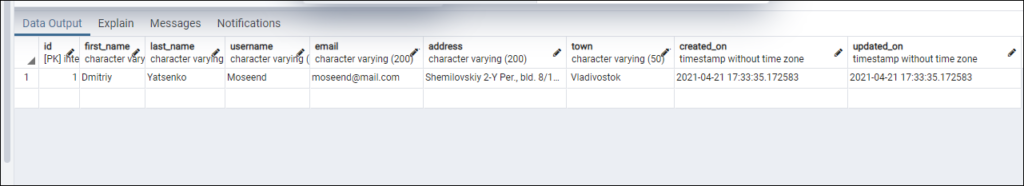

Сейчас таблица Customer выглядит вот так:

Пока что покупатели ничего не приобрели. Поэтому c1.orders и c2.orders вернут пустой список.

[] []Добавим еще потребителей в таблицу customers:

from sqlalchemy import create_engine

from sqlalchemy.orm import Session, sessionmaker

engine = create_engine("postgresql+psycopg2://postgres:1111@localhost/sqlalchemy_tuts")

session = Session(bind=engine)

c3 = Customer(

first_name = "Vadim",

last_name = "Moiseenko",

username = "Antence73",

email = "antence73@mail.com",

)

c4 = Customer(

first_name = "Vladimir",

last_name = "Belousov",

username = "Andescols",

email = "andescols@mail.com",

)

c5 = Customer(

first_name = "Tatyana",

last_name = "Khakimova",

username = "Caltin1962",

email = "caltin1962@mail.com",

)

c6 = Customer(

first_name = "Pavel",

last_name = "Arnautov",

username = "Lablen",

email = "lablen@mail.com",

)

session.add_all([c3, c4, c5, c6])

session.commit()

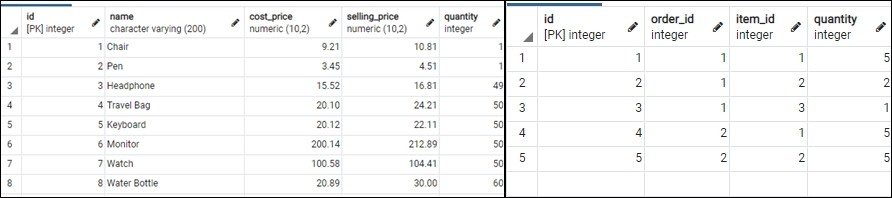

Также добавим продукты в таблицу items:

i1 = Item(name = 'Chair', cost_price = 9.21, selling_price = 10.81, quantity = 5)

i2 = Item(name = 'Pen', cost_price = 3.45, selling_price = 4.51, quantity = 3)

i3 = Item(name = 'Headphone', cost_price = 15.52, selling_price = 16.81, quantity = 50)

i4 = Item(name = 'Travel Bag', cost_price = 20.1, selling_price = 24.21, quantity = 50)

i5 = Item(name = 'Keyboard', cost_price = 20.1, selling_price = 22.11, quantity = 50)

i6 = Item(name = 'Monitor', cost_price = 200.14, selling_price = 212.89, quantity = 50)

i7 = Item(name = 'Watch', cost_price = 100.58, selling_price = 104.41, quantity = 50)

i8 = Item(name = 'Water Bottle', cost_price = 20.89, selling_price = 25, quantity = 50)

session.add_all([i1, i2, i3, i4, i5, i6, i7, i8])

session.commit()

Создадим заказы:

o1 = Order(customer = c1)

o2 = Order(customer = c1)

line_item1 = OrderLine(order = o1, item = i1, quantity = 3)

line_item2 = OrderLine(order = o1, item = i2, quantity = 2)

line_item3 = OrderLine(order = o2, item = i1, quantity = 1)

line_item3 = OrderLine(order = o2, item = i2, quantity = 4)

session.add_all([o1, o2])

session.new

session.commit()

В данном случае в сессию добавляются только объекты Order (o1 и o2). Order и OrderLine связаны отношением один-ко-многим. Добавление объекта Order в сессию неявно добавляет также и объекты OrderLine. Но даже если добавить последние вручную, ошибки не будет.

Вместо передачи объекта Order при создании экземпляра OrderLine можно сделать следующее:

o3 = Order(customer = c1)

orderline1 = OrderLine(item = i1, quantity = 5)

orderline2 = OrderLine(item = i2, quantity = 10)

o3.line_items.append(orderline1)

o3.line_items.append(orderline2)

session.add_all([o3,])

session.new

session.commit()

После коммита таблицы orders и order_lines будут выглядеть вот так:

Если сейчас получить доступ к атрибуту orders объекта Customer, то вернется не-пустой список.

[<Order:1>, <Order:2>]С другой стороны отношения можно получить доступ к объекту Customer, которому заказ принадлежит через атрибут customer объекта Order — o1.customer.

Сейчас у покупателя c1 три заказа. Чтобы посмотреть все пункты в заказе нужно использовать атрибут line_items объекта Order.

c1.orders[0].line_items, c1.orders[1].line_items

([<OrderLine:1>, <OrderLine:2>], [<OrderLine:3>, <OrderLine:4>])Для получения элемента заказа используйте item.

for ol in c1.orders[0].line_items:

ol.id, ol.item, ol.quantity

print('-------')

for ol in c1.orders[1].line_items:

ol.id, ol.item, ol.quantity

Вывод:

(1, <Item:1-Chair>, 3)

(2, <Item:2-Pen>, 2)

-------

(3, <Item:1-Chair>, 1)

(4, <Item:2-Pen>, 4)

Все это возможно благодаря отношениям relationship() моделей.

Получение данных

Чтобы сделать запрос в базу данных используется метод query() объекта session. Он возвращает объект типа sqlalchemy.orm.query.Query, который называется просто Query. Он представляет собой инструкцию SELECT, которая будет использована для запроса в базу данных. В следующей таблице перечислены распространенные методы класса Query.

| Метод | Описание |

|---|---|

| all() | Возвращает результат запроса (объект Query) в виде списка |

| count() | Возвращает общее количество записей в запросе |

| first() | Возвращает первый результат из запроса или None, если записей нет |

| scalar() | Возвращает первую колонку первой записи или None, если результат пустой. Если записей несколько, то бросает исключение MultipleResultsFound |

| one | Возвращает одну запись. Если их несколько, бросает исключение MutlipleResultsFound. Если данных нет, бросает NoResultFound |

| get(pk) | Возвращает объект по первичному ключу (pk) или None, если объект не был найден |

| filter(*criterion) | Возвращает экземпляр Query после применения оператора WHERE |

| limit(limit) | Возвращает экземпляр Query после применения оператора LIMIT |

| offset(offset) | Возвращает экземпляр Query после применения оператора OFFSET |

| order_by(*criterion) | Возвращает экземпляр Query после применения оператора ORDER BY |

| join(*props, **kwargs) | Возвращает экземпляр Query после создания SQL INNER JOIN |

| outerjoin(*props, **kwargs) | Возвращает экземпляр Query после создания SQL LEFT OUTER JOIN |

| group_by(*criterion) | Возвращает экземпляр Query после добавления оператора GROUP BY к запросу |

| having(criterion) | Возвращает экземпляр Query после добавления оператора HAVING |

Метод all()

В базовой форме метод query() принимает в качестве аргументов один или несколько классов модели или колонок. Следующий код вернет все записи из таблицы customers.

from sqlalchemy import create_engine

from sqlalchemy.orm import Session

engine = create_engine("postgresql+psycopg2://postgres:1111@localhost/sqlalchemy_tuts")

session = Session(bind=engine)

print(session.query(Customer).all())

[<Customer:1-Moseend>,

<Customer:2-Fortioneaks>,

<Customer:3-Antence73>,

<Customer:4-Andescols>,

<Customer:5-Caltin1962>,

<Customer:6-Lablen>]Так же можно получить записи из таблиц items и orders.

Чтобы получить сырой SQL, который используется для выполнения запроса в базу данных, примените sqlalchemy.orm.query.Query следующим образом: print(session.query(Customer)).

SELECT

customers. ID AS customers_id,

customers.first_name AS customers_first_name,

customers.last_name AS customers_last_name,

customers.username AS customers_username,

customers.email AS customers_email,

customers.address AS customers_address,

customers.town AS customers_town,

customers.created_on AS customers_created_on,

customers.updated_on AS customers_updated_on

FROM

customersВызов метода all() на большом объекте результата не очень эффективен. Вместо этого стоит использовать цикл for для перебора по объекту Query:

q = session.query(Customer)

for c in q:

print(c.id, c.first_name)

Предыдущие запросы вернули данные из всех колонок таблицы. Предотвратить это можно, передав названия колонок явно в метод query():

print(session.query(Customer.id, Customer.first_name).all())

Вывод:

[(1, 'Dmitriy'),

(2, 'Valeriy'),

(3, 'Vadim'),

(4, 'Vladimir'),

(5, 'Tatyana'),

(6, 'Pavel')]Обратите внимание на то, что каждый элемент списка — это кортеж, а не экземпляр модели.

Метод count()

count() возвращает количество элементов в результате.

session.query(Item).count()

# Вывод - 8

Метод first()

first() возвращает первый результат запроса или None, если последний не вернул данных.

session.query(Order).first()

# Вывод - Order:1

Метод get()

get() возвращает экземпляр с соответствующим первичным ключом или None, если такой объект не был найден.

session.query(Customer).get(1)

# Вывод - Customer:1-Moseend

Метод filter()

Этот метод позволяет отфильтровать результаты, добавив оператор WHERE. Он принимает колонку, оператор и значение. Например:

session.query(Customer).filter(Customer.first_name == 'Vadim').all()Этот запрос вернет всех покупателей, чье имя — Vadim. А вот SQL-эквивалент этого запроса:

print(session.query(Customer).filter(Customer.first_name == 'Vadim'))

SELECT

customers.id AS customers_id,

customers.first_name AS customers_first_name,

customers.last_name AS customers_last_name,

customers.username AS customers_username,

customers.email AS customers_email,

customers.address AS customers_address,

customers.town AS customers_town,

customers.created_on AS customers_created_on,

customers.updated_on AS customers_updated_on

FROM

customers

WHERE

customers.first_name = %(first_name_1)sСтрока %(first_name_1)s в операторе WHERE — это заполнитель, который будет заменен на реальное значение (Vadim) при выполнении запроса.

Можно передать несколько фильтров в метод filter() и они будут объединены с помощью оператора AND. Например:

session.query(Customer).filter(Customer.id <= 5, Customer.last_name == "Arnautov").all()

Этот запрос вернет всех покупателей, чей первичный ключ меньше или равен 5, а фамилия начинается с "Ar".

session.query(Customer).filter(Customer.id <= 5, Customer.last_name.like("Ar%")).all()

Еще один способ комбинировать условия — союзы (and_(), or_() и not_()). Некоторые примеры:

# все клиенты с именем Vadim и Tatyana

session.query(Customer).filter(or_(

Customer.first_name == 'Vadim',

Customer.first_name == 'Tatyana'

)).all()

# найти всех с именем и Pavel фамилией НЕ Yatsenko

session.query(Customer).filter(and_(

Customer.first_name == 'Pavel',

not_(

Customer.last_name == 'Yatsenko',

)

)).all()

Следующий перечень демонстрирует, как использовать распространенные операторы сравнения с методом filter().

IS NULL

session.query(Order).filter(Order.date_placed == None).all()IS NOT NULL

session.query(Order).filter(Order.date_placed != None).all()

IN

session.query(Customer).filter(Customer.first_name.in_(['Pavel', 'Vadim'])).all()NOT INT

session.query(Customer).filter(Customer.first_name.notin_(['Pavel', 'Vadim'])).all()BETWEEN

session.query(Item).filter(Item.cost_price.between(10, 50)).all()NOT BETWEEN

session.query(Item).filter(not_(Item.cost_price.between(10, 50))).all()

LIKE

session.query(Item).filter(Item.name.like("%r")).all()

Метод like() выполняет поиск с учетом регистра. Для поиска совпадений без учета регистра используйте ilike().

session.query(Item).filter(Item.name.ilike("w%")).all()

NOT LIKE

session.query(Item).filter(not_(Item.name.like("W%"))).all()

Метод limit()

Метод limit() добавляет оператор LIMIT к запросу. Он принимает количество записей, которые нужно вернуть.

session.query(Customer).limit(2).all()

session.query(Customer).filter(Customer.username.ilike("%Andes")).limit(2).all()

SQL-эквивалент:

SELECT

customers. id AS customers_id,

customers.first_name AS customers_first_name,

customers.last_name AS customers_last_name,

customers.username AS customers_username,

customers.email AS customers_email,

customers.address AS customers_address,

customers.town AS customers_town,

customers.created_on AS customers_created_on,

customers.updated_on AS customers_updated_on

FROM

customers

LIMIT %(param_1)s Метод offset()

Метод offset() добавляет оператор OFFSET к запросу. Он принимает в качестве аргумента значение смещения. Часто используется с оператором limit().

session.query(Customer).limit(2).offset(2).all()

SQL-эквивалент:

SELECT

customers. ID AS customers_id,

customers.first_name AS customers_first_name,

customers.last_name AS customers_last_name,

customers.username AS customers_username,

customers.email AS customers_email,

customers.address AS customers_addrees,

customers.town AS customers_town,

customers.created_on AS customers_created_on,

customers.updated_on AS customers_updated_on

FROM

customers

LIMIT %(param_1)s OFFSET %(param_2)sМетод order_by()

Метод order_by() используется для сортировки результата с помощью оператора ORDER BY. Он принимает названия колонок, по которым необходимо сортировать результат. По умолчанию сортирует по возрастанию.

session.query(Item).filter(Item.name.ilike("wa%")).all()

session.query(Item).filter(Item.name.ilike("wa%")).order_by(Item.cost_price).all()

Чтобы сортировать по убыванию используйте функцию desc():

from sqlalchemy import desc

session.query(Item).filter(Item.name.ilike("wa%")).order_by(desc(Item.cost_price)).all()

Метод join()

Метод join() используется для создания SQL INNER JOIN. Он принимает название таблицы, с которой нужно выполнить SQL JOIN.

Используем join(), чтобы найти всех покупателей, у которых как минимум один заказ.

session.query(Customer).join(Order).all()

SQL-эквивалент:

SELECT

customers.id AS customers_id,

customers.first_name AS customers_first_name,

customers.last_name AS customers_last_name,

customers.username AS customers_username,

customers.email AS customers_email,

customers.address AS customers_address,

customers.town AS customers_town,

customers.created_on AS customers_created_on,

customers.updated_on AS customers_updated_on

FROM

customers

JOIN orders ON customers.id = orders.customer_id

Этот оператор часто используется для получения данных из одной или нескольких таблиц в одном запросе. Например:

session.query(Customer.id, Customer.username, Order.id).join(Order).all()

Можно создать SQL JOIN для более чем двух таблиц, объединив несколько методов join() следующим образом:

session.query(Table1).join(Table2).join(Table3).join(Table4).all()

Вот еще один пример, который использует 3 объединения для нахождения всех пунктов в первом заказе Dmitriy Yatsenko.

session.query(

Customer.first_name,

Item.name,

Item.selling_price,

OrderLine.quantity

).join(Order).join(OrderLine).join(Item).filter(

Customer.first_name == 'Dmitriy',

Customer.last_name == 'Yatsenko',

Order.id == 1,

).all()

Метод outerjoin()

Метод outerjoin() работает как join(), но создает LEFT OUTER JOIN.

session.query(

Customer.first_name,

Order.id,

).outerjoin(Order).all()

В этом запросе левой таблицей является customers. Это значит, что он вернет все записи из customers и только те, которые соответствуют условию, из orders.

Создать FULL OUTER JOIN можно, передав в метод full=True. Например:

session.query(

Customer.first_name,

Order.id,

).outerjoin(Order, full=True).all()

Метод group_by()

Результаты группируются с помощью group_by(). Этот метод принимает одну или несколько колонок и группирует записи в соответствии со значениями в колонке.

Следующий запрос использует join() и group_by() для подсчета количества заказов, сделанных Dmitriy Yatsenko.

from sqlalchemy import func

session.query(func.count(Customer.id)).join(Order).filter(

Customer.first_name == 'Dmitriy',

Customer.last_name == 'Yatsenko',

).group_by(Customer.id).scalar()

Метод having()

Чтобы отфильтровать результаты на основе значений, которые возвращают агрегирующие функции, используется метод having(), добавляющий оператор HAVING к инструкции SELECT. По аналогии с where() он принимает условие.

session.query(

func.count("*").label('username_count'),

Customer.town

).group_by(Customer.username).having(func.count("*") > 2).all()

Работа с дубликатами

Для работы с повторяющимися записями используется параметр DISTINCT. Его можно добавить к SELECT с помощью метода distinct(). Например:

from sqlalchemy import distinct

session.query(Customer.first_name).filter(Customer.id < 10).all()

session.query(Customer.first_name).filter(Customer.id < 10).distinct().all()

session.query(

func.count(distinct(Customer.first_name)),

func.count(Customer.first_name)

).all()

Приведение

Приведение (конвертация) данных от одного типа к другому — распространенная операция, которая выполняется с помощью функции cast() из библиотеки sqlalchemy.

from sqlalchemy import cast, Date, distinct, union

session.query(

cast(func.pi(), Integer),

cast(func.pi(), Numeric(10,2)),

cast("2010-12-01", DateTime),

cast("2010-12-01", Date),

).all()

Объединения

Для объединения запросов используется метод union() объекта Query. Он принимает один или несколько запросов. Например:

s1 = session.query(Item.id, Item.name).filter(Item.name.like("Wa%"))

s2 = session.query(Item.id, Item.name).filter(Item.name.like("%e%"))

s1.union(s2).all()

[(2, 'Pen'),

(4, 'Travel Bag'),

(3, 'Headphone'),

(5, 'Keyboard'),

(7, 'Watch'),

(8, 'Water Bottle')]По умолчанию union() удаляет все повторяющиеся записи из результата. Для их сохранения используйте union_all().

s1.union_all(s2).all()Обновление данных

Для обновления объекта просто установите новое значение атрибуту, добавьте объект в сессию и сохраните ее.

i = session.query(Item).get(8)

i.selling_price = 25.91

session.add(i)

session.commit()

Таким образом можно обновлять только один объект за раз. Для обновления нескольких записей за раз используйте метод update() объекта Query. Он возвращает общее количество обновленных записей. Например:

session.query(Item).filter(

Item.name.ilike("W%")

).update({"quantity": 60}, synchronize_session='fetch')

session.commit()

Удаление данных

Для удаления объекта используйте метод delete() объекта сессии. Он принимает объект и отмечает его как удаленный для следующего коммита.

i = session.query(Item).filter(Item.name == 'Monitor').one()

session.delete(i)

session.commit()

<Item:6-Monitor>Этот коммит удаляет Monitor из таблицы items.

Для удаления нескольких записей за раз используйте метод delete() объекта Query.

session.query(Item).filter(

Item.name.ilike("W%")

).delete(synchronize_session='fetch')

session.commit()

Этот коммит удаляет все элементы, название которых начинается с W.

Сырые(raw) запросы

ORM предоставляет возможность использовать сырые SQL-запросы с помощью функции text(). Например:

from sqlalchemy import text

session.query(Customer).filter(text("first_name = 'Vladimir'")).all()

session.query(Customer).filter(text("username like 'Cal%'")).all()

session.query(Customer).filter(text("username like 'Cal%'")).order_by(text("first_name, id desc")).all()

Транзакции

Транзакция — это способ выполнения набора SQL-инструкций так, что выполняются или все вместе, или ни одна из них. Если хотя бы одна инструкция из транзакции была провалена, база данных возвращается к предыдущему состоянию.

В базе данных есть два заказа, в процессе отгрузки заказа есть такие этапы:

- В колонке

date_placedтаблицыordersустанавливается дата отгрузки. - Количество заказанных товаров вычитается из

items.

Оба действия должны быть выполнены как одно, чтобы убедиться, что данные в таблицах корректны.

В следующем коде определяем метод dispatch_order(), который принимает order_id в качестве аргумента и выполняет описанные выше задачи в одной транзакции.

def dispatch_order(order_id):

# проверка того, правильно ли указан order_id

order = session.query(Order).get(order_id)

if not order:

raise ValueError("Недействительный order_id: {}.".format(order_id))

try:

for i in order.line_items:

i.item.quantity = i.item.quantity - i.quantity

order.date_placed = datetime.now()

session.commit()

print("Транзакция завершена.")

except IntegrityError as e:

print(e)

print("Возврат назад...")

session.rollback()

print("Транзакция не удалась.")

dispatch_order(1)

В первом заказе 3 стула и 2 ручки. dispatch_order() с идентификатором заказа 1 даст следующий вывод:

Транзакция завершена.ORM построен на базе SQLAlchemy Core, поэтому имеющиеся знания должны пригодиться.

ORM позволяет быть более продуктивным, но также добавляет дополнительную сложность в запросы. Однако для большинства приложений преимущества перевешивают проигрыш в производительности.

Прежде чем двигаться дальше удалите все таблицы из sqlalchemy-tuts с помощью следующей команды: metadata.drop_all(engine).

Создание моделей

Модель — это класс Python, соответствующий таблице в базе данных, а его свойства — это колонки.

Чтобы класс был валидной моделью, нужно соответствовать следующим требованиям:

- Наследоваться от декларативного базового класса с помощью вызова функции

declarative_base(). - Объявить имя таблицы с помощью атрибута

__tablename__. - Объявить как минимум одну колонку, которая должна быть частью первичного ключа.

Последние два пункта говорят сами за себя, а вот для первого нужны детали.

Базовый класс управляет каталогом классов и таблиц. Другими словами, декларативный базовый класс — это оболочка над маппером и MetaData. Маппер соотносит подкласс с таблицей, а MetaData сохраняет всю информацию о базе данных и ее таблицах. По аналогии с Core в ORM методы create_all() и drop_all() объекта MetaData используются для создания и удаления таблиц.

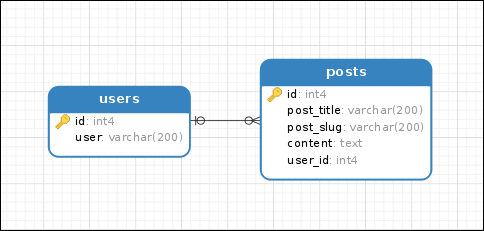

Следующий код показывает, как создать модель Post, которая используется для сохранения постов в блоге.

from sqlalchemy import create_engine, MetaData, Table, Integer, String, \

Column, DateTime, ForeignKey, Numeric

from sqlalchemy.ext.declarative import declarative_base

from datetime import datetime

Base = declarative_base()

class Post(Base):

__tablename__ = 'posts'

id = Column(Integer, primary_key=True)

title = Column(String(100), nullable=False)

slug = Column(String(100), nullable=False)

content = Column(String(50), nullable=False)

published = Column(String(200), nullable=False, unique=True)

created_on = Column(DateTime(), default=datetime.now)

updated_on = Column(DateTime(), default=datetime.now, onupdate=datetime.now)

Разберем построчно:

- На 1-4 строках импортируются нужные классы и функции.

- В 6 строке создается базовый класс с помощью вызова функции

declarative_base(). - На 10-16 строках колонки объявляются как атрибуты класса.

Стоит обратить внимание на то, что для создания колонок используется тот же класс Column, что и для SQLAlchemy Core. Единственное отличие в том, что первым аргументом является тип, а не название колонки. Аргументы-ключевые слова, в свою очередь, переданные в Column(), работают одинаково в ORM и Core.

Поскольку ORM построен на базе Core, SQLAlchemy использует определение модели для создания объекта Table и связи его с моделью с помощью функции mapper(). Это завершает процесс маппинга модели Post с соответствующим экземпляром Table. Теперь модель Post можно использовать для управления базой данных и для осуществления запросов к ней.

Классический маппинг

После прошлого раздела может создаться впечатление, что для использования SQLAlchemy ORM нужно переписать все экземпляры Table в виде моделей. Но это не так.

Можно запросто мапить любые Python классы на экземпляры Table с помощью функции mapper(). Например:

from sqlalchemy import MetaData, Table, Integer, String, Column, Text, DateTime, Boolean

from sqlalchemy.orm import mapper

from datetime import datetime

metadata = MetaData()

post = Table('post', metadata,

Column('id', Integer(), primary_key=True),

Column('title', String(200), nullable=False),

Column('slug', String(200), nullable=False),

Column('content', Text(), nullable=False),

Column('published', Boolean(), default=False),

Column('created_on', DateTime(), default=datetime.now),

Column('updated_on', DateTime(), default=datetime.now, onupdate=datetime.now)

)

class Post(object):

pass

mapper(Post, post)

Этот класс принимает два аргумента: класс для маппинга и объект Table.

После этого у класса Post будут атрибуты, соответствующие колонкам таблицы. Таким образом у Post сейчас следующие атрибуты:

post.idpost.titlepost.slugpost.contentpost.publishedpost.created_onpost.updated_on

Код в списке выше эквивалентен модели Post, которая была объявлена выше.

Теперь вы должны лучше понимать, что делает declarative_base().

Добавление ключей и ограничений

При использовании ORM ключи и ограничения добавляются с помощью атрибута __table_args__.

from sqlalchemy import Table, Index, Integer, String, Column, Text, \

DateTime, Boolean, PrimaryKeyConstraint, \

UniqueConstraint, ForeignKeyConstraint

from sqlalchemy.ext.declarative import declarative_base

from datetime import datetime

Base = declarative_base()

class User(Base):

__tablename__ = 'users'

id = Column(Integer)

username = Column(String(100), nullable=False)

email = Column(String(100), nullable=False)