Ollama: Ejecuta Modelos de Lenguaje Localmente con Facilidad

Ollama es una herramienta de código abierto diseñada para Windows que permite a los usuarios ejecutar cualquier modelo de lenguaje en su máquina local. Al aprovechar la potencia de procesamiento de tu computadora, esta herramienta facilita la generación de respuestas sin depender de un LLM en línea. Incluso con recursos limitados, Ollama garantiza respuestas consistentes, aunque más lentas con hardware ineficiente.

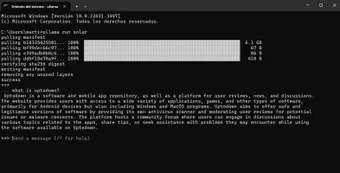

Instalar varios modelos como Llama 3, Phi 3, Mistral o Gemma es sencillo con Ollama. Al introducir comandos específicos como 'ollama run llama3' en la consola, puedes iniciar el proceso de instalación. Ollama lleva a cabo conversaciones a través de Windows CMD por defecto y recomienda tener el doble del espacio libre en disco en comparación con el tamaño de cada LLM añadido para un rendimiento óptimo.