Newsroom

Meet our latest news and insights

Featured

[CTO 인터뷰] LLM 추론 특화 AI 반도체 설계 회사 하이퍼엑셀… 이진원 CTO “GPU 대신 비용 절감형 LPU로 승부”

비싼 HBM 버리고 가성비 D램 채택“LLM 추론 효율 엔비디아 압도할 것”삼성 4나노로 ‘베르다’ 시제품 제작네이버·LG와 손잡고 데이터센터·가전 정조준 “인공지능(AI) 서비스...

[CTO Interview] HyperAccel bets LPU to cut LLM inference costs and challenge Nvidia in Korea

Korean startup’s LPU chip targets cheaper LLM inference with DRAM and Samsung 4nm backing “The core goal is to bring...

AI computing shifts from training to inference; heterogeneous architectures go mainstream

As generative AI continues to advance, its capabilities and application scenarios are rapidly expanding, driving structural changes in computing infrastructure....

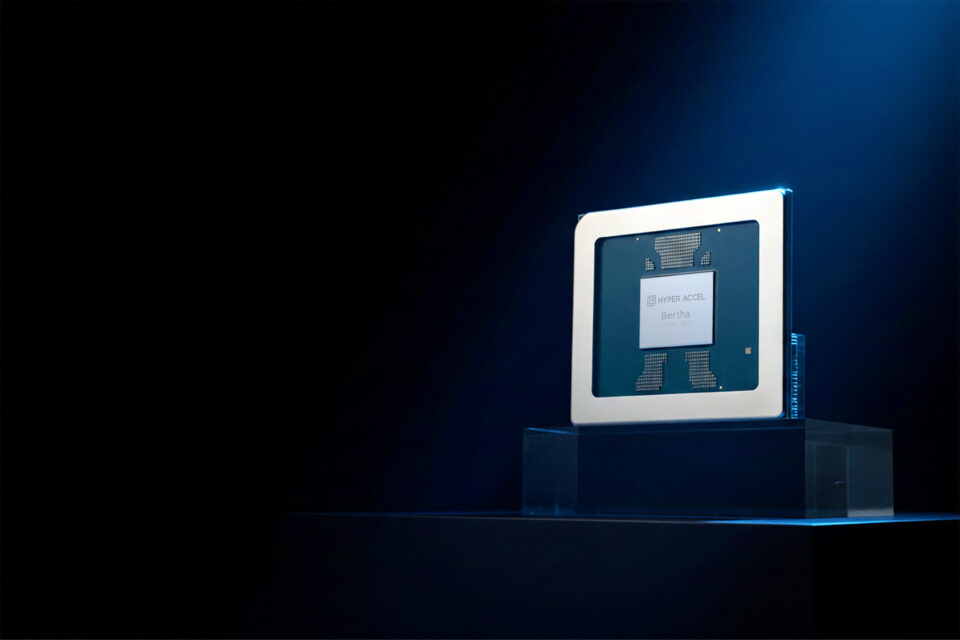

[CEO Interview] Korean startup targets Nvidia-dominated AI inference market with 2027 chip launch

Hyper Accel CEO Kim Joo-young poses for a photo with the company’s first AI chip, codenamed Bertha 500, during an...

하이퍼엑셀-업스테이지, ‘독파모’ 합류…LLM 추론 인프라 고도화 나선다

AI 반도체 스타트업 하이퍼엑셀이 업스테이지 컨소시엄을 통해 정부 ‘독자 AI 파운데이션 모델(독파모)’ 협력 생태계에 합류한다. 하이퍼엑셀은 생성형 AI의 실제 응용...

Korean Startup Takes On Cost and Latency With LLM-Specific Chip

HyperAccel is also working with LG on an SoC version for edge appliances and robots. South Korean AI chip startup...

HyperAccel and Advantech Sign MOU for AI Infrastructure Technology Collaboration

AI semiconductor startup HyperAccel announced on the 3rd that it has signed a memorandum of understanding (MOU) with Advantech, a...

하이퍼엑셀, 대만 어드밴텍과 양해각서 체결··· ‘LPU 확산에 시동’

AI 반도체 기술 기업 하이퍼엑셀이 대만의 산업용 디바이스 및 사물인터넷 전문 제조 기업 어드밴텍(Advantech)과 AI 인프라 기술 협력을 위한 양해각서를...

[CEO Interview] ‘World’s First LPU AI Chip’ Achieved by Korean Startup: “2.4 Times Better Performance Than Conventional GPUs” [Future of K-Semiconductors ①]

Kim Joo-Young, CEO of HyperAccelSpecialized Chip for Advanced LLM Operation2.4 Times the Performance of AI GPUs50% Faster Processing SpeedPrimarily Used...

[CEO Interview] ‘세계 첫 LPU AI칩’ 韓 스타트업이 해냈다…”기존 GPU보다 성능 2.4배”[K반도체의 미래①]

김주영 하이퍼엑셀 대표LLM 구동 고도화에 특화 칩AI용 GPU보다 성능 2.4배처리 속도 50% 더 빨라져네이버 클라우드에 주로 사용 연말엔 LG전자와 공동개발‘온디바이스...

[AWS 기술 블로그] 하이퍼엑셀(HyperAccel), Amazon EC2 F2 Instance 기반 LPU로 고효율 LLM 추론 서비스 구축

by JinHyeok Lee and Minhae Kim on 09 1월 2026 in Advanced (300), Amazon EC2, AWS MarketplacePermalink Share Amazon EC2 F2 인스턴스는 AWS가 제공하는 FPGA(Field-Programmable Gate Array) 기반 컴퓨팅 인스턴스로, 고객이 하드웨어...